|

. |

|||||||||||||||||

|

|

|

|

|

|

|

||||||||||||

|

|

|||||||||||||||||

|

|

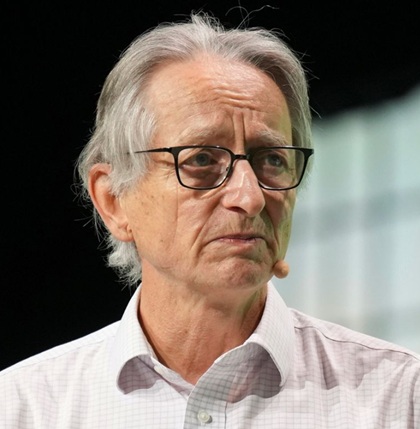

Geoffrey Hinton, Entdecker des Deep LearningGeoffrey Hinton, bekannt als der »Pate der KI«, erhielt den Preis für seine wegweisende Arbeit an neuronalen Netzwerken, insbesondere für die Entwicklung des Deep Learning. Dieses Verfahren ermöglicht es KI-Systemen, aus Daten zu lernen und ihre Leistung zu verbessern, was entscheidende Fortschritte in Bereichen wie Spracherkennung, Bildverarbeitung und maschineller Übersetzung ermöglicht hat. Geoffrey Hinton ist ein britisch-kanadischer Informatiker und Neurowissenschaftler, der als einer der führenden Köpfe der KI gilt. Besonders bekannt wurde er durch seine wegweisende Arbeit an Neuronalen Netzwerken und die Entwicklung von Deep Learning. In den 1980er Jahren war er maßgeblich an der Wiederentdeckung und Verbesserung des Backpropagation-Algorithmus beteiligt, der es Neuronalen Netzen ermöglicht, aus Daten zu lernen. Dies legte den Grundstein für viele der heutigen KI-Anwendungen, von Spracherkennung bis hin zur Bildanalyse. Hinton entwickelte auch das Konzept der »Boltzmann-Maschinen«, eine Klasse von neuronalen Netzen, die zur Mustererkennung und Datenverarbeitung verwendet werden. Seine Arbeiten haben große Auswirkungen auf zahlreiche wissenschaftliche und industrielle Bereiche, darunter die Medizin und autonome Systeme. Für seine Leistungen wurde Hinton bereits mehrfach ausgezeichnet, darunter mit dem Turing Award 2019 und dem Nobelpreis für Physik 2024. |

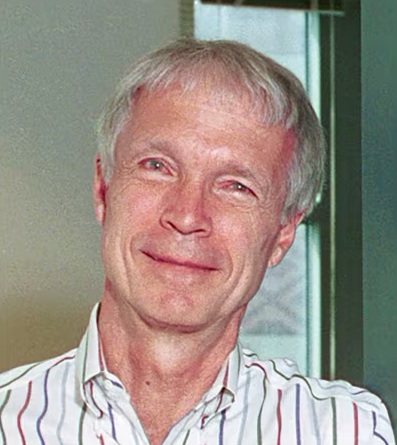

John HopfieldJohn Hopfield wurde für die Erfindung des Hopfield-Netzwerks geehrt, einem Modell für assoziatives Gedächtnis, das in der Lage ist, Muster zu speichern und wieder abzurufen. John Hopfield ist ein US-amerikanischer Physiker und Neurowissenschaftler, der für die Entwicklung des Hopfield-Netzwerks bekannt ist, einem Modell für assoziatives Gedächtnis in neuronalen Netzwerken. Dieses Netzwerk speichert Informationen in Form von stabilen Zuständen, die abgerufen werden können, ähnlich wie das menschliche Gedächtnis arbeitet. Seine bahnbrechende Arbeit in den 1980’er Jahren trug erheblich zur Verbindung von Physik und Neurowissenschaften bei und inspirierte viele weitere Entwicklungen im Bereich der KI und der neuronalen Netze. Neben dem Hopfield-Netzwerk hat er auch zur statistischen Physik beigetragen und die mathematischen Grundlagen der künstlichen neuronalen Netze vertieft, die später für moderne Deep-Learning-Algorithmen genutzt wurden. Seine Forschung hat Anwendungen in der KI, von Musterspeicherung bis hin zu Optimierungsmethoden, vorangetrieben. |

Was ist "Deep Learning" ? |

|

|

Deep Learning ist ein Teilbereich des Maschinellen Lernens, der auf künstlichen Neuronalen Netzwerken basiert. Diese Netzwerke sind inspiriert vom menschlichen Gehirn und bestehen aus mehreren Schichten von „Neuronen“ (Knoten), die Daten verarbeiten und Muster erkennen können. Deep Learning ist besonders leistungsfähig, weil es große Datenmengen durch zahlreiche Schichten von Neuronen verarbeitet, um komplexe Zusammenhänge und Merkmale zu lernen. Was Deep Learning von anderen Methoden unterscheidet, ist die Tiefe des Netzwerks, d. h. die Anzahl der Schichten, durch die die Daten verarbeitet werden. Diese tiefen Netzwerke können sehr feinkörnige Muster erkennen und haben Anwendungen in Bereichen wie Spracherkennung, Bildverarbeitung (z. B. Gesichtserkennung), maschinelle Übersetzung und autonomes Fahren. |

Durch den Einsatz von Algorithmen wie dem Backpropagation-Verfahren kann ein Deep-Learning-Modell seine Leistung kontinuierlich verbessern, indem es aus Fehlern lernt und die Verbindungen zwischen den Neuronen anpasst. Ein besonders bekanntes Beispiel ist der Einsatz von Deep Learning in Neuronalen Netzen wie Convolutional Neural Networks (CNNs) für die Bilderkennung und Recurrent Neural Networks (RNNs) für die Verarbeitung von Sequenzdaten wie Text oder Sprache. (•) Mehr zum Thema 'Lernen' |

|

|

||||||

|

||||||

|

© 2026 | Copyright by Paulo Heitlinger |

||||||